摘要:日志是运维的“黑匣子”,但其快速增长会迅速吞噬磁盘空间。本文提供一套从日志压缩、自动轮转到低成本长期归档的完整策略,包含详尽的logrotate配置、rsync/云存储实战案例及最佳实践,助您将日志从负担转化为可管理的资产。

一、引言:为什么需要专业的日志管理?

想象一下,在一个凌晨,收到磁盘空间超过95%的告警,缘由是未经管理的日志文件写满了整个/var分区。这不仅是性能问题,更可能导致服务崩溃、数据丢失和合规风险。

- 存储成本:未经压缩的日志可能占用TB级空间。

- 合规要求:如GDPR、PCI DSS等法规要求日志保留数年。

- 运维价值:历史日志是故障排查和安全审计的唯一线索。

一套自动化的压缩与归档策略,是系统稳定性和可维护性的基石。

二、核心策略:压缩与归档的黄金组合

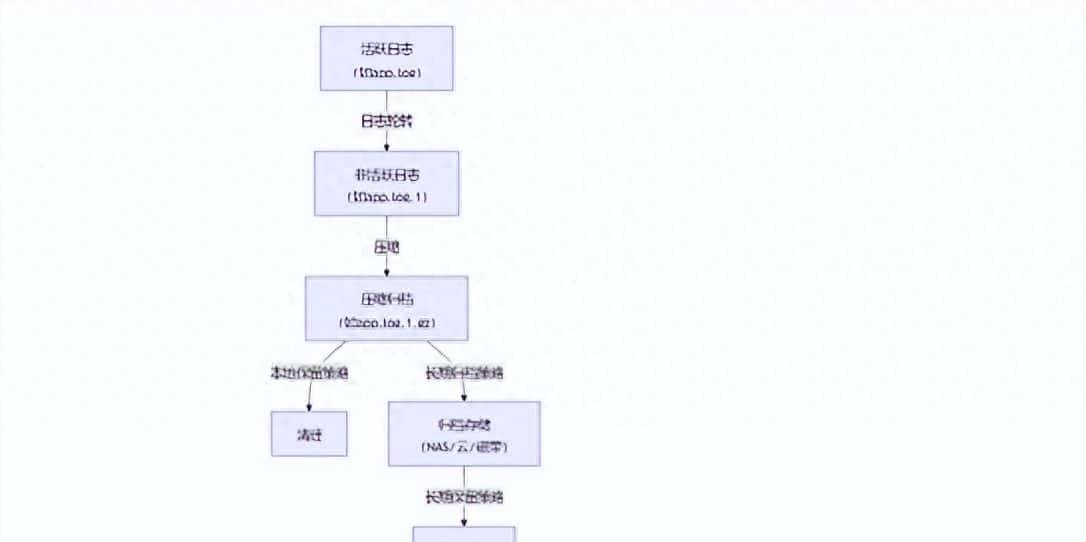

日志管理并非简单删除,而是一个生命周期管理过程。其核心工作流如下图所示:

压缩与归档在此流程中扮演不同角色:

- 日志压缩:侧重于空间节省,利用算法减少日志文件体积,是归档的前提步骤。

- 日志归档:侧重于生命周期管理,将日志安全地转移到低成本存储介质,并定义保留策略。

三、实战日志压缩:工具选型与性能权衡

压缩的本质是消除数据冗余。不同的工具在压缩率、速度和CPU开销上各有权衡。

3.1 主流压缩工具对比

|

工具 |

命令 |

压缩率 |

速度 |

CPU开销 |

适用场景 |

|

gzip |

gzip file.log |

中等 (~60-70%) |

快 |

低 |

日志轮转、日常压缩,最佳平衡点 |

|

bzip2 |

bzip2 file.log |

高 (~70-80%) |

慢 |

中 |

对空间敏感,不关心速度的场景 |

|

xz |

xz file.log |

极高 (~80-95%) |

超级慢 |

高 |

长期归档,追求极致空间节省 |

结论:对于日常日志管理,gzip是理想选择。对于需要永久保留的归档包,可以思考使用xz以获得最大压缩率。

3.2 代码示例:基础与高级用法

1. 基础压缩与解压

# 使用 gzip 压缩,原文件会被替换为 file.log.gz

gzip /var/log/app/file.log

# 使用 gunzip 解压

gunzip /var/log/app/file.log.gz

# 使用 xz 压缩

xz /var/log/app/audit.log2. 打包并压缩整个日志目录

# 使用 tar 打包目录,并用 gzip 压缩 (-z)

tar -czvf app_logs_$(date +%Y%m%d).tar.gz /var/log/app/

# 使用 xz 压缩的 tar 包 (-J)

tar -cJvf app_logs_$(date +%Y%m%d).tar.xz /var/log/app/- -c: 创建归档。

- -z: 使用gzip过滤。

- -J: 使用xz过滤。

- -v: 显示详细过程。

- -f: 指定归档文件名。

3. 使用多线程工具pigz加速压缩

pigz是gzip的替代品,它利用多核心CPU大幅提升压缩速度。

# 安装 pigz (Ubuntu/Debian)

sudo apt install pigz

# 压缩单个文件,使用所有CPU核心

pigz /var/log/app/large_file.log

# 与 tar 配合:-c 创建归档,--use-compress-program=pigz 指定压缩程序

tar -c --use-compress-program=pigz -vf archive.tar.gz /var/log/app/四、自动化核心:使用 Logrotate 实现日志轮转与压缩

手动管理日志不可持续。logrotate是Linux系统自带的自动化日志轮转工具,是整套策略的“大脑”。

4.1 Logrotate 工作原理

logrotate根据预设的周期(天、周、月)或文件大小,自动将当前日志文件重命名(如access.log -> access.log.1),并通知应用程序生成新的日志文件。它可以自动对旧日志进行压缩、删除或邮寄。

4.2 实战配置示例

假设我们有一个应用日志/var/log/myapp/app.log,需要实现:

- 每日轮转。

- 保留最近30个日志文件。

- 缺失日志不报错。

- 轮转后立即压缩(使用gzip)。

- 如果日志文件为空,则不轮转。

- 轮转后发送信号给应用(如HUP)以重新打开日志文件。

创建配置文件:/etc/logrotate.d/myapp

# /etc/logrotate.d/myapp 配置文件

/var/log/myapp/app.log {

daily # 轮转周期:每天

rotate 30 # 保留30个轮转后的文件

missingok # 如果日志丢失,继续而不报错

compress # 轮转后压缩旧日志

delaycompress # 延迟压缩:压缩上一个轮转的日志(即压缩 .log.1,不压缩刚轮转出来的 .log.1)

notifempty # 如果日志为空,则不轮转

create 0640 appuser appgroup # 创建新日志文件的权限和属主

postrotate # 轮转后执行的脚本

# 向应用程序发送信号,让其重新打开日志文件

/bin/kill -HUP `cat /var/run/myapp.pid 2> /dev/null` 2> /dev/null || true

endscript

}手动立即执行一次轮转以测试配置:

sudo logrotate -vf /etc/logrotate.d/myapp- -v: 详细输出。

- -f: 强制轮转。

五、长期归档策略:从本地到云端

归档是将压缩后的日志文件从生产服务器迁移到低成本存储的过程。

5.1 归档存储介质选择

|

介质 |

优点 |

缺点 |

适用场景 |

|

本地/NAS |

速度快,访问方便 |

无异地容灾 |

短期归档,快速检索 |

|

对象存储(S3/OSS) |

高持久性,无限扩展,异地 |

有流量成本,检索可能慢 |

主要长期归档方案 |

|

磁带库 |

成本极低 |

检索速度极慢 |

海量数据冷归档,合规性存档 |

5.2 实战归档方法

1. 使用 Rsync 归档到本地NAS或备份服务器

#!/bin/bash

# archive_logs.sh

# 变量定义

SOURCE_DIR="/var/log/myapp/"

BACKUP_SERVER="backup-user@192.168.1.100"

BACKUP_PATH="/mnt/archive/logs/$(hostname)"

# 使用 rsync 进行同步,-z 参数在传输时压缩以节省带宽

rsync -avz --delete $SOURCE_DIR/*.gz $BACKUP_SERVER:$BACKUP_PATH/

echo "归档完成于 $(date)"- 将此脚本加入cron,每周执行一次:0 2 * * 0 /path/to/archive_logs.sh

2. 加密归档到 AWS S3(安全最佳实践)

对于敏感日志,应在客户端加密后再上传。

#!/bin/bash

# encrypt_and_archive_to_s3.sh

# 变量定义

LOG_DIR="/var/log/myapp"

BACKUP_FILE="myapp_logs_$(date +%Y-%m-%d).tar.gz"

S3_BUCKET="s3://my-company-logs-archive"

GPG_RECIPIENT="log-archive@mycompany.com" # GPG公钥对应的邮箱

# 1. 打包并压缩日志

tar -czf $BACKUP_FILE $LOG_DIR/*.gz

# 2. 使用GPG非对称加密备份文件

gpg --encrypt --recipient $GPG_RECIPIENT --output $BACKUP_FILE.gpg $BACKUP_FILE

# 3. 使用 AWS CLI 上传到 S3 冰川深度归档层(成本最低)

aws s3 cp $BACKUP_FILE.gpg $S3_BUCKET/ --storage-class DEEP_ARCHIVE

# 4. 清理本地临时文件

rm -f $BACKUP_FILE $BACKUP_FILE.gpg

echo "加密归档至S3完成于 $(date)"六、完整实战案例:Nginx日志管理

目标:Nginx访问日志access.log,每天轮转,压缩后保留30天,并每月归档一次到AWS S3。

1. Logrotate 配置 (/etc/logrotate.d/nginx)

/var/log/nginx/access.log /var/log/nginx/error.log {

daily

rotate 30

missingok

compress

delaycompress

notifempty

create 0640 www-data adm

postrotate

invoke-rc.d nginx rotate > /dev/null

endscript

}2. 月度归档脚本 (

/usr/local/bin/archive_nginx_to_s3.sh)

#!/bin/bash

# 将上个月的日志打包上传到S3

YEAR_MONTH=$(date -d "last month" +%Y-%m)

BACKUP_FILE="nginx_logs_${YEAR_MONTH}.tar.gz"

S3_BUCKET="s3://my-company-nginx-logs"

# 打包上个月的所有.gz文件

tar -czf /tmp/$BACKUP_FILE /var/log/nginx/access.log.*.gz /var/log/nginx/error.log.*.gz

# 上传到S3标准-infrequent access层(性价比高)

aws s3 cp /tmp/$BACKUP_FILE $S3_BUCKET/$YEAR_MONTH/ --storage-class STANDARD_IA

# 可选:上传成功后删除本地旧文件

# find /var/log/nginx -name "*.gz" -mtime +30 -delete

rm -f /tmp/$BACKUP_FILE3. 配置Cron任务

# 每月1号凌晨2点执行归档

0 2 1 * * /usr/local/bin/archive_nginx_to_s3.sh七、最佳实践总结

- 策略先行:根据合规和业务需求,明确日志的保留期限(如:7天在线,30天本地压缩,7年归档)。

- 自动化一切:依赖logrotate和cron,避免手动操作。

- 安全第一:对含有敏感信息(IP、用户数据)的日志,加密后再归档。

- 监控与告警:监控归档脚本的执行结果和存储空间,确保流程持续健康。

- 成本优化:使用云存储的分层功能(如S3 Standard-IA/Glacier),将冷数据转移到更低成本的层级。

通过实施以上策略,您可以构建一个健壮、高效且低成本的日志管理体系,彻底解决日志管理的后顾之忧。

相关文章